“Comprendiendo las búsquedas mejor que nunca”, así presenta BERT Pandu Nayak (Google Fellow and Vice President, Search), indicando que el 15% de las búsquedas diarias que recibe la empresa son sobre algo que no habían visto antes, por lo que el reto ha sido ofrecer resultados a consultas que no pueden anticipar.

A la hora de realizar una búsqueda el usuario está acostumbrado a poner una secuencia de palabras clave, algo que no haría si estuviese preguntándole a alguien. Y según Google esto se va a acabar con BERT: “Con los últimos avances de nuestro equipo de investigación en la ciencia de la comprensión del lenguaje, que han sido posibles gracias al aprendizaje automático, estamos mejorando significativamente la forma en que entendemos las consultas, lo que representa el mayor avance en los últimos cinco años y uno de los mayores avances en la historia de la búsqueda”, según Nayak.

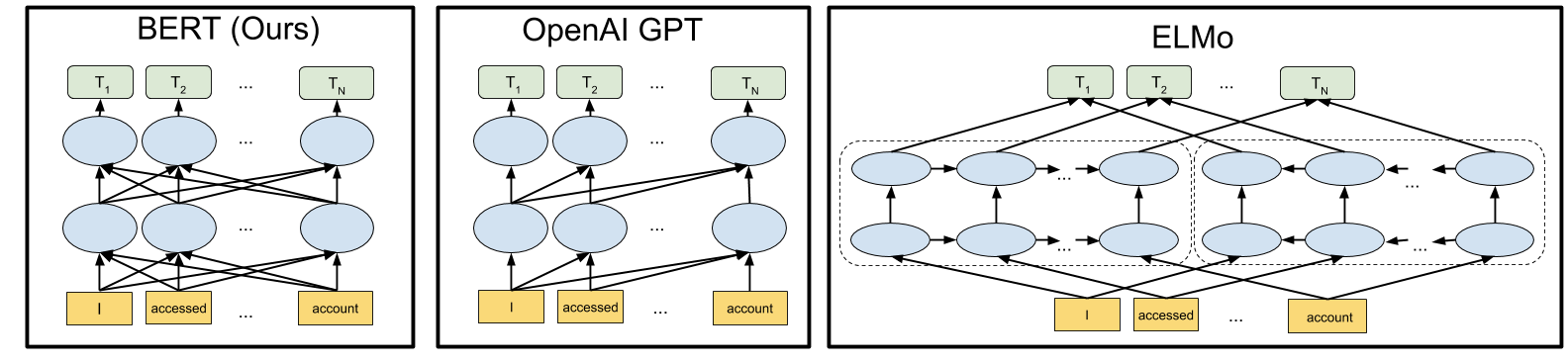

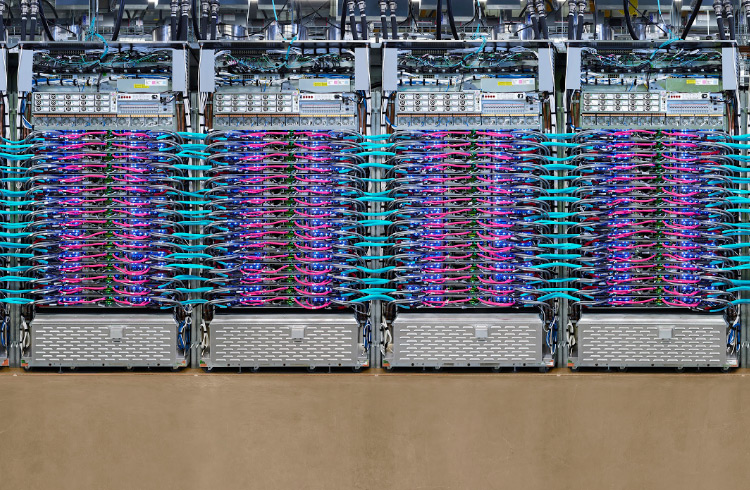

El año pasado Google introdujo una red neuronal de código abierto para el procesamiento del lenguaje natural (PNL) llamada Bidirectional Encoder Representations from Transformers (BERT), que logra considerar el contexto completo de una palabra observando las palabras que aparecen antes y después de ella, especialmente útiles para comprender la intención que hay detrás de las consultas de búsqueda. Para conseguirlo han aprovechado la potencia del Cloud para obtener información relevante más rápidamente.

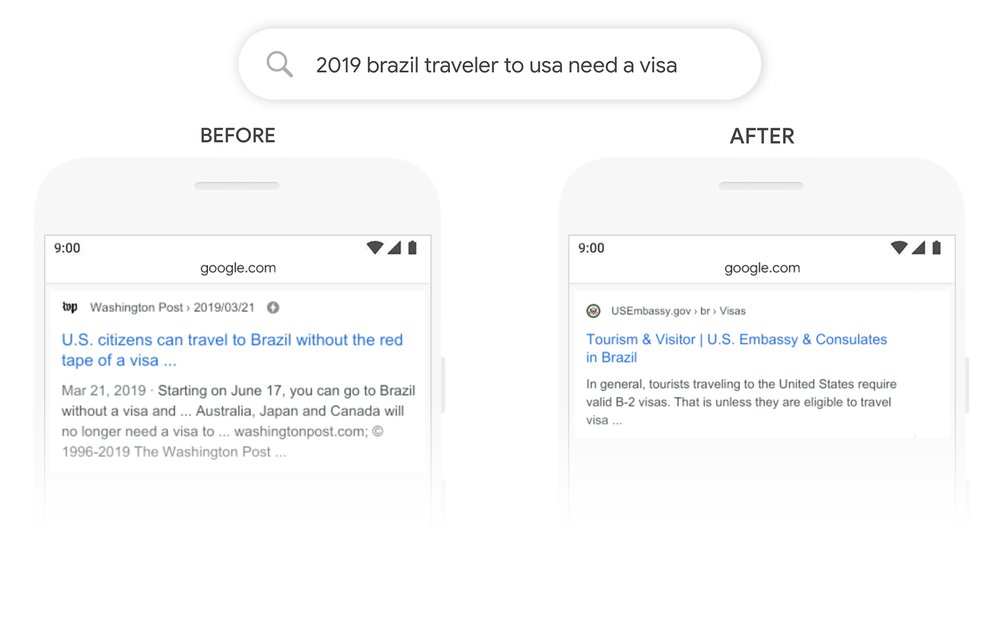

Se estima que BERT ayudará a entender mejor 1 de cada 10 búsquedas en los Estados Unidos en inglés (y más adelante en otros idiomas), sobre todo en las consultas más largas donde aparezcan preposiciones como “para”, “de” o “a”. Para ello han realizado muchas pruebas, como por ejemplo en la búsqueda “2019 brazil traveler to usa need a visa”, donde BERT entiende el matiz que “to” da a la frase. En las anteriores búsquedas el resultado podía ser erróneo como muestra la imagen de la izquierda (los Estadounidenses pueden viajar a Brasil sin Visa), pero en la segunda el resultado sí es el correcto (qué documentación necesitan los brasileños que van a Estados Unidos).

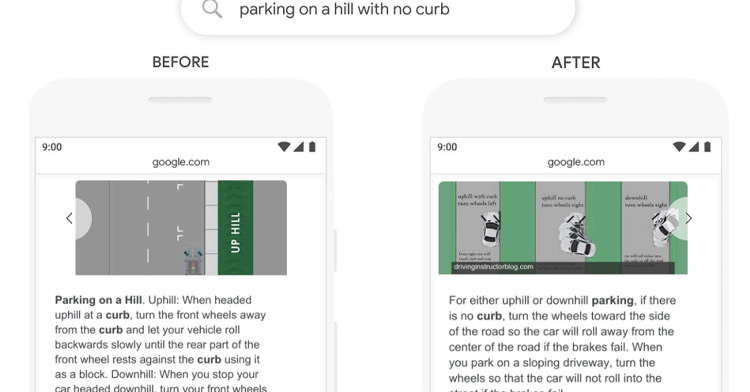

En otro ejemplo, “aparcando en una colina sin bordillo”, el sistema le daba mucha importancia a “bordillo” pero ignoraba la preposición “sin”, con lo cual daba un resultado de búsqueda para aparcar en una colina “con” bordillo. BERT entiende ahora el contexto de la frase y devuelve un resultado correcto para la consulta. Por último, Nayak asegura que BERT puede “tomar los aprendizajes de un idioma y aplicarlos a otros”, así que tenlo en cuenta a partir de ahora para tu SEO.